LLZO Bake-off P2(foundation vs custom)¶

LLZOデータセットで、汎用foundationモデルと自前customモデルを同一条件で比較しました。

主指標では custom が大幅に改善し、実運用向けの精度水準に近づく結果でした。

Proof Packと再現情報を以下に公開します。

指標サマリ(strict test split)¶

| Variant | Energy MAE (meV/atom) | Force RMSE (eV/A) |

|---|---|---|

| foundation | 600543.1311 | 0.442339 |

| custom | 9.7834 | 0.015659 |

指標サマリーの見方(初心者向け / 上級者向け)¶

初心者向け(まずここだけ読めばOK)¶

このページでは、汎用モデル(foundation)と、LLZO向けに学習した自前モデル(custom)を、同じテストデータで比較しています。

見るべき指標は2つです(どちらも 小さいほど良い):

-

Force RMSE(eV/Å):原子にかかる「力」のズレ

→ 分子動力学(MD)で原子を動かすときの“ハンドル”が力です。

この値が小さいほど、MDが安定して回りやすい傾向があります。 -

Energy MAE(meV/atom):エネルギーのズレ(原子1個あたり)

→ 「その構造がどれだけ安定か」を判断する指標の一つです。

この値が小さいほど、安定/不安定の判断が当たりやすい傾向があります。

ひとことで言うと:

Forceが当たる=MDが回せる可能性が上がる / Energyが当たる=安定性の評価が当たりやすい

よくある疑問:なぜ foundation の Energy が極端に大きい?¶

汎用モデルは「LLZOという材料のエネルギー基準(オフセット)や学習領域」が合わないと、エネルギー誤差が非常に大きく出ることがあります。

このページの結果は「LLZOに対しては 汎用モデルをそのまま使うのは難しく、LLZOデータで学習したモデルが必要」という判断材料になります。

上級者向け(定義・計算方法・注意点)

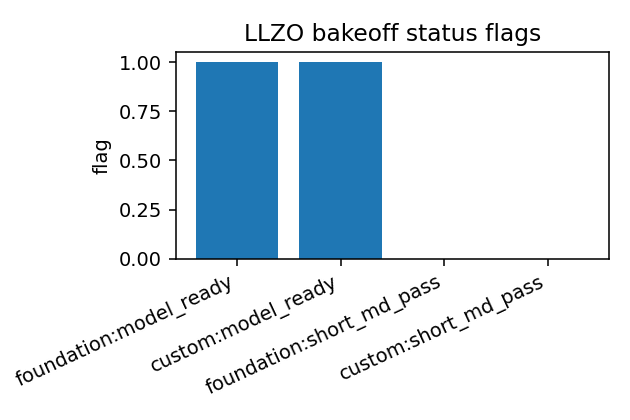

### 指標の定義(概念) - **Energy MAE(meV/atom)**: テストセット各構造について、参照エネルギーと予測エネルギーの差の絶対値を平均し、原子数で正規化したもの(meV/atom換算)。 - **Force RMSE(eV/Å)**: テストセット各構造について、参照力ベクトルと予測力ベクトルの二乗誤差を平均して平方根を取ったもの(RMSE)。 ### 実装上の注意 - テストセット(extxyz)は `energy_ry` のみ保持する場合があり、参照エネルギーは `energy_ry -> eV` へ変換して評価しています。 - “status flags” は精度指標ではなく、後述の**動作チェック(合否)**です。比較図¶

図の「status flags(動作チェック)」とは?¶

初心者向け¶

これは精度の指標ではなく、テストが通ったかどうか(合否)です。

- 1 = PASS(動いた / 完走した)

- 0 = FAIL(途中で止まった / 条件を満たさなかった)

たとえば:

- model_ready:モデルが読み込めて評価可能な状態か

- short_md_pass:短いMD(ショートMD)が完走したか

ここが0だと「精度以前に、まず動かない」状態なので、まず修正が必要、という意味になります。

上級者向け(チェック項目の意味)

- `model_ready`:モデルファイルの整合性、ロード、必要な前処理が完了して評価に入れるか - `short_md_pass`:短いMDの実行が、設定した条件(時間/ステップ/エラーなし)で完走したかProof Pack¶

- Proof Pack (ZIP): /assets/downloads/proofpacks/llzo/llzo_bakeoff_20260228_115713.zip

- SHA256: /assets/downloads/proofpacks/llzo/llzo_bakeoff_20260228_115713.sha256

再現手順は Runbook として提供予定です。

REPORT.md(全文)

# LLZO Bake-off Report (20260228_115713) - dataset: `/home/dl/work/servergear-gpu-runbook/tools/sg-llzo-qe-dataset/out/dataset/llzo_tier1.extxyz` - foundation_model: `/home/dl/.local/sg/allegro/models/Allegro-OAM-L-0.1.nequip.zip` - custom_model: `/home/dl/work/servergear-gpu-runbook/tools/sg-llzo-allegro-train/out/models/20260228_113749/deployed/model.nequip.pth` - logs: `/home/dl/work/servergear-gpu-runbook/tools/sg-llzo-bakeoff/out/logs/20260228_115713` ## Metricsvariant,metric,value,unit,notes

dataset,n_configs,200,count,from extxyz

dataset,energy_mae_proxy,0.07224606756302364,Ry,MAE vs dataset mean

foundation,model_ready,1,flag,/home/dl/.local/sg/allegro/models/Allegro-OAM-L-0.1.nequip.zip

custom,model_ready,1,flag,/home/dl/work/servergear-gpu-runbook/tools/sg-llzo-allegro-train/out/models/20260228_113749/deployed/model.nequip.pth

foundation,strict_eval_frames,20,count,test extxyz

foundation,energy_mae_mev_atom,600543.1310884466,meV/atom,strict test split

foundation,force_rmse_ev_a,0.4423391158808407,eV/A,strict test split

custom,strict_eval_compile_fallback,1,flag,compile_ase_failed_using_direct_model

custom,strict_eval_frames,20,count,test extxyz

custom,energy_mae_mev_atom,9.783399474804355,meV/atom,strict test split

custom,force_rmse_ev_a,0.015659338701591263,eV/A,strict test split

foundation,short_md_pass,0,flag,see /home/dl/work/servergear-gpu-runbook/tools/sg-llzo-bakeoff/out/logs/20260228_115713/md_foundation.log

custom,short_md_pass,0,flag,see /home/dl/work/servergear-gpu-runbook/tools/sg-llzo-bakeoff/out/logs/20260228_115713/md_custom.log